Haber

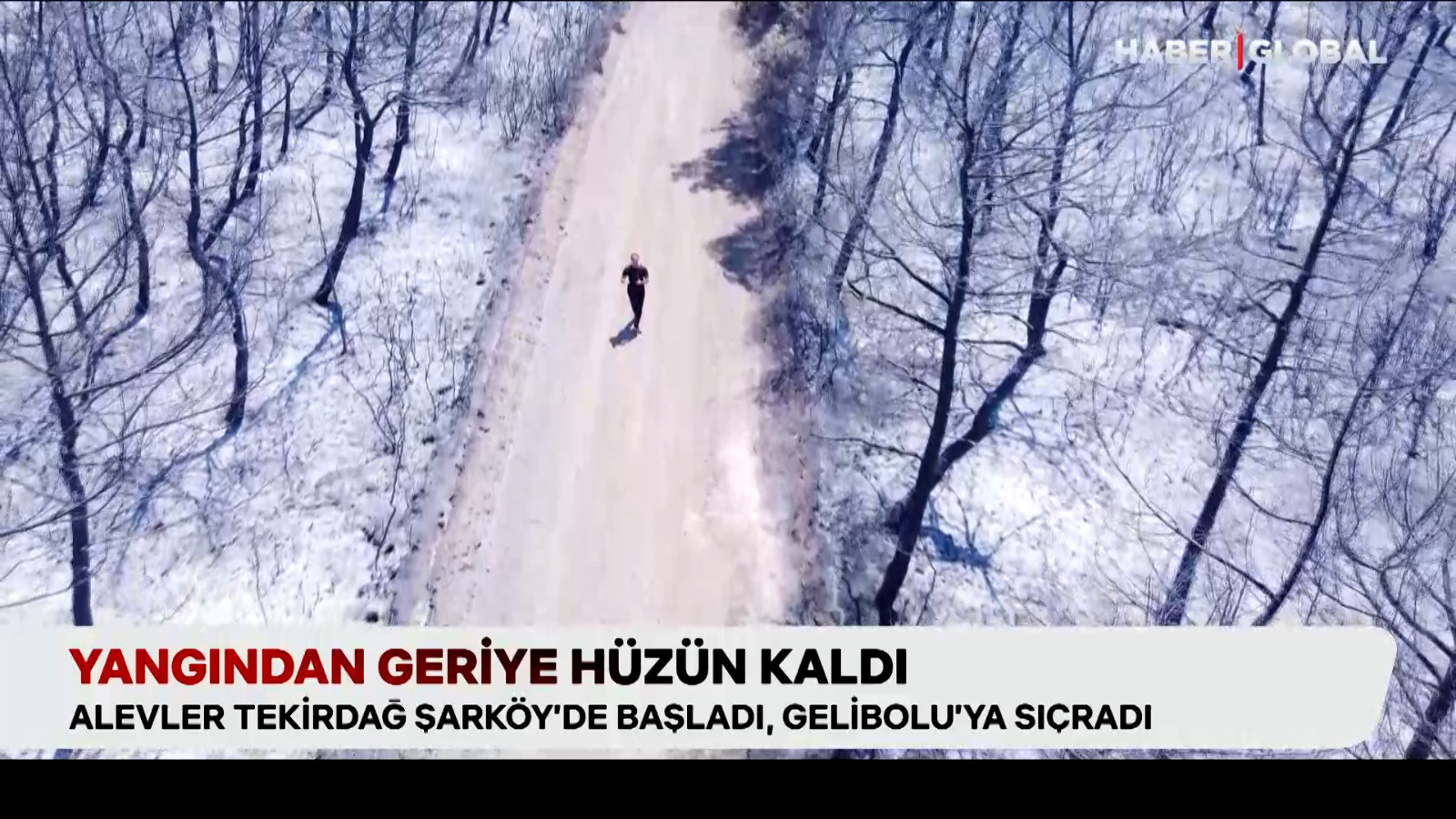

Yangının Ardında Bıraktığı Hüzün

Şenköy Mahallesi’nde, önceki gün öğle saatlerinde, orman dışı bir alanda henüz belirlenemeyen bir nedenle çıkan yangın, Gelibolu ilçesine bağlı Kavakköy beldesinin kırsal bölgelerine kadar ulaştı. Yangın, geniş bir alanı etkisi altına alarak büyük bir üzüntü yarattı.

Yangın söndürme çalışmalarını sürdüren ekipler, alevlerin etkili olduğu bölgelerde inceleme ve tarama işlemlerine devam ediyor. Bu süreçte, yanan alanların durumu hakkında detaylı bilgi edinilmesi hedefleniyor.