WordPress Üyelik Formuna TC Kimlik Doğrulama Eklentisi Yayında

WordPress sitenizin üyelik sayfasına TC Kimlik, Ad-Soyad, doğum yılı doğrulaması ilave eden eklentimiz yayına sunuldu. (BETA)

WordPress’in klasik üyelik formunda e-mail veya kullanıcı adı istenir. Kullanıcılara giriş parolası e-posta yoluyla iletilir. Bilhos tarafından geliştirilen eklenti sayesinde kullanıcılardan TC Kimlik No, Ad-Soyad, Doğum Yılı bilgisi girmesini isteyebilir, yanlış bilgi girenlerin üyelik yapmasını engelleyebilirsiniz. Eklenti, girilen bilgileri T.C. İçişleri Bakanlığı, Nüfus ve Vatandaşlık İşleri Genel Müdürlüğü‘nün halka açık (public) SOAP API servisi kanalıyla resmi ve legal olarak doğrulanmaktadır. Bilhos TC Kimlik Doğrulama eklentisi, sahte bilgilerle açılan üyelikleri engellediği gibi spam üyeliklerden korunmak adına da alternatif bir çözüm bulunur. Resmi işlemler veya başvuruların işlendiği WordPress sistemler için ideal bir çözümdür. Bilhos TC Kimlik Doğrulama eklentisi kullanıcı adı ve TC kimlik no arasında ilişki kurar ve aynı TC kimlik no ile mükerrer üyelikler açılmasına engel olur.

Eklentimiz yakın zaman içerisinde WordPress Eklenti Havuzu’nda yerini alacaktır. Aşağıdaki indirme bağlantısından zip formatında bilgisayarınıza indirebilirsiniz.

Not: İndirme linkinin görünmesi için Tweet veya Beğeni yapmanız gerekmektedir.

Eklenti dosyasını indirdikten sonra WordPress Admin konsolunda Eklentiler > Yeni Eklenti Ekle yolunu takip edin. İndirdiğiniz zip dosyasını seçip yükleyin. Eklenti başarıyla yüklendikten sonra “Etkinleştir” ifadesine tıklayın. Üyelik formunuza Ad Soyad, Doğum Yılı, TC Kimlik No alanları ilave edilecek ve doğrulama sistemi devreye girecektir.

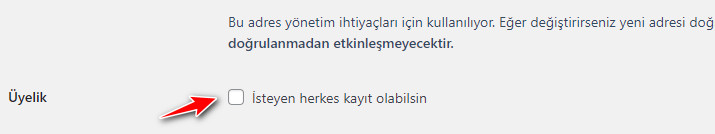

NOT 2: Eklentinin çalışabilmesi için WordPress blogunuza üyelik alımlarının aktif durumda olması gerekir. Bu ayarı siteniz.tld/wp-admin/options-general.php kısmından değiştirebilirsiniz. “İsteyen herkes kayıt olabilsin” ifadesini işaretli olmalıdır.

Bilgisayar ve İnternet Dünyasına Dair Her Türlü Soru veya Sorununuzu Soru Sor sayfamızdan bizlere iletebilirsiniz. Sorularınız En Kısa Sürede Cevaplanacaktır.

Bilhos derlendi.